Wystąpienie doktora Dariusza Wylona podczas konferencji Stowarzyszenie PR i Promocji Uczelni Polskich “PRom” bardzo dobrze pokazało, że sztuczna inteligencja może realnie usprawnić pracę uczelni – w dydaktyce, badaniach, administracji, promocji i komunikacji. Nie jest jednak magicznym rozwiązaniem ani zastępstwem dla człowieka. Jej wartość zależy od tego, czy użytkownicy potrafią jasno formułować polecenia, chronić dane, sprawdzać źródła i krytycznie oceniać wyniki.

AI może przyspieszyć pracę i zwiększyć dostępność wiedzy, ale odpowiedzialność za jakość, poprawność i bezpieczne wykorzystanie efektów pozostaje po stronie człowieka.

Podsumowanie

Dr Wylon omówił przede wszystkim znakomite narzędzia Google wykorzystywane w edukacji i pracy akademickiej: Gemini, NotebookLM, GEM-y oraz Flow.

Każde z nich pełni inną funkcję:

Gemini działa jak ogólny asystent AI. Może pomagać w tworzeniu tekstów, prezentacji, analiz, pomysłów komunikacyjnych czy instrukcji. W Gemini można też tworzyć własnych wyspecjalizowanych asystentów, czyli GEM-y. Taki asystent może mieć określoną rolę, styl wypowiedzi, zadanie, format odpowiedzi i zestaw dokumentów źródłowych.

NotebookLM jest szczególnie przydatny w edukacji, ponieważ pracuje na materiałach dostarczonych przez użytkownika: artykułach, podręcznikach, plikach PDF, stronach internetowych, filmach, obrazach lub wklejonym tekście. Na tej podstawie może przygotowywać streszczenia, quizy, fiszki, mapy myśli, prezentacje, podcasty i odpowiedzi na pytania. Ważną zaletą jest możliwość wskazywania źródeł, z których pochodzą informacje.

Flow służy do tworzenia obrazów i krótkich filmów. Pozwala budować wizualne narracje, łączyć sceny, edytować obrazy i przygotowywać materiały dydaktyczne lub promocyjne. Może pomóc np. w wizualizacji epok historycznych, scen literackich, kampusu uczelni czy przyszłych scenariuszy społecznych.

Warto mieć na uwadze bezpieczeństwo danych: konta edukacyjne i korporacyjne zapewniają większą kontrolę nad prywatnością, zgodność z RODO i ograniczenie wykorzystywania danych do trenowania modeli. Korzystanie z prywatnych kont do pracy z danymi studentów, pracowników lub materiałami wewnętrznymi może być ryzykowne.

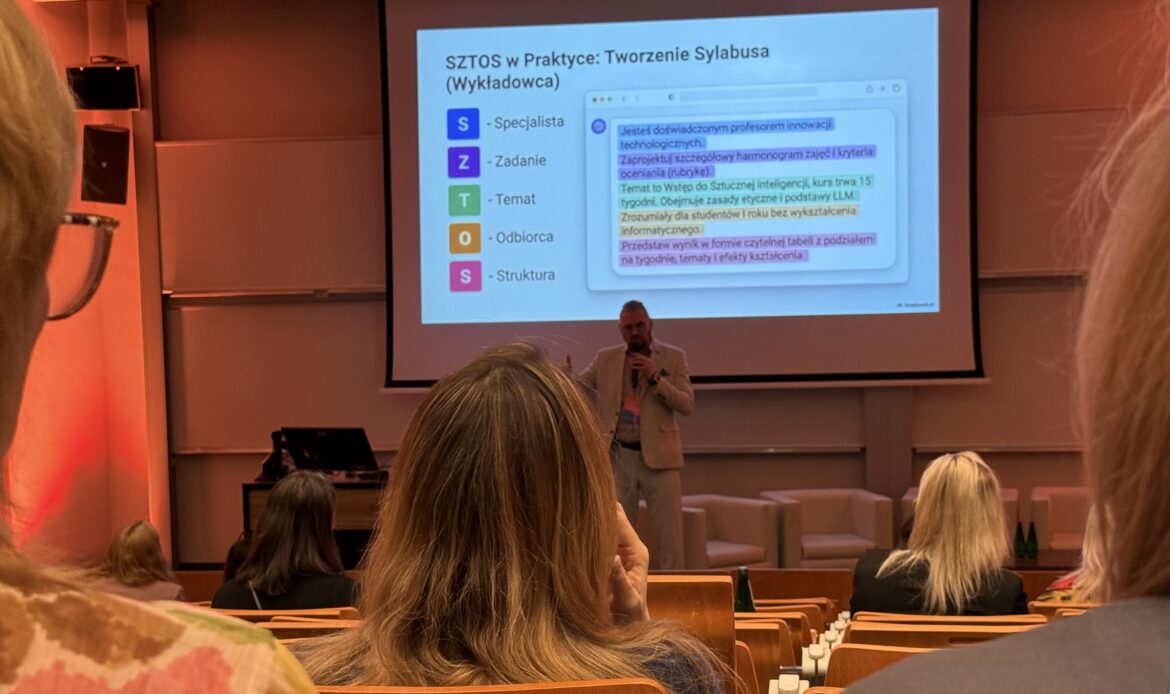

Istotnym tematem jest również promptowanie, czyli sztuka formułowania poleceń dla AI. Dr Wylon zaproponował schemat SZTOS:

S – specjalista: kim ma być AI,

Z – zadanie: co ma zrobić,

T – temat: czego dotyczy praca,

O – odbiorca: dla kogo powstaje odpowiedź,

S – struktura: w jakiej formie ma zostać przygotowany wynik.

Dobrze napisany prompt działa jak jasny brief dla współpracownika. Im dokładniej użytkownik opisze cel, kontekst i oczekiwany format, tym lepszy będzie rezultat.

Najważniejsze myśli z wystąpienia

AI jako pomocnik, nie zastępca człowieka

AI to nasz współpracownik któremu możemy szybko przygotować pierwszą wersję tekstu, raportu, prezentacji albo analizy, ale człowiek musi ją przeczytać, sprawdzić i poprawić.

To ważne, ponieważ modele AI mogą się mylić. Potrafią tworzyć przekonujące, ale błędne odpowiedzi, źle interpretować dane lub wskazywać nieistniejące źródła. Dlatego AI najlepiej traktować jako narzędzie przyspieszające pracę, a nie jako nieomylny autorytet.

Rola i instrukcja zmieniają jakość odpowiedzi

Sposób, w jaki użytkownik opisze rolę AI, mocno wpływa na odpowiedź. Inaczej odpowie „profesor zarządzania strategicznego”, inaczej „nauczyciel przedsiębiorczości”, a jeszcze inaczej „tutor dla ucznia szkoły podstawowej”.

To podobne do rozmowy z różnymi specjalistami. Rzecznik prasowy, wykładowca i trener biznesu mogą mówić o tym samym problemie, ale każdy użyje innego języka, przykładów i poziomu szczegółowości.

Dlatego tworząc GEM-a lub zwykły prompt, warto określić:

rolę asystenta,

cel działania,

odbiorcę,

ton wypowiedzi,

format odpowiedzi,

ograniczenia,

źródła, z których ma korzystać.

Dobrze zaprojektowany asystent może potem wykonywać powtarzalne zadania, np. przygotowywać komunikaty promocyjne, analizować ankiety, tworzyć materiały dla studentów albo pomagać w komunikacji kryzysowej.

NotebookLM jako narzędzie do nauki opartej na źródłach

NotebookLM wyróżnia się tym, że działa jak rozmowa z bibliotekarzem, który zna tylko dokumenty położone przed nim na biurku. Jeśli użytkownik wgra podręcznik, artykuły lub regulaminy, narzędzie odpowiada na podstawie tych materiałów.

To ogranicza ryzyko halucynacji, choć go całkowicie nie usuwa. Użytkownik nadal powinien sprawdzać, czy odpowiedź poprawnie oddaje sens źródła.

W edukacji NotebookLM może wspierać różne style uczenia się. Ten sam materiał można przekształcić w:

streszczenie,

fiszki,

quiz,

mapę myśli,

tabelę,

prezentację,

podcast,

zestaw pytań i odpowiedzi.

Dzięki temu student, który woli słuchać, może uczyć się z nagrania, a osoba preferująca obraz – z mapy myśli lub infografiki. Narzędzie może też pomóc osobom z trudnościami wzrokowymi, zamieniając materiały tekstowe na wersję audio.

Personalizacja i umiędzynarodowienie edukacji

AI może dopasowywać poziom odpowiedzi do odbiorcy. Student pierwszego roku może poprosić o proste wyjaśnienie trudnego artykułu, doktorant o analizę bardziej specjalistyczną, a wykładowca o krytyczne omówienie źródła.

Narzędzia AI wspierają też edukację międzynarodową. Student może zadawać pytania w swoim języku, nawet jeśli materiały źródłowe są po angielsku. Podobnie badacz może wstępnie zorientować się w treści tekstu napisanego w języku, którego nie zna. Takie rozwiązania zmniejszają barierę językową i poszerzają dostęp do wiedzy.

GEM-y jako wyspecjalizowani asystenci uczelni

GEM-y w Gemini pozwalają tworzyć asystentów do konkretnych zadań. Prelegent podaje przykłady zastosowań w uczelni:

analiza szkół średnich pod kątem rekrutacji,

przekształcanie artykułów naukowych w teksty popularnonaukowe,

tworzenie postów do mediów społecznościowych,

przygotowywanie komunikacji kryzysowej,

analiza opinii studentów,

wspieranie studentów w trybie tutora.

Taki asystent może przygotować uporządkowany raport, wskazać interesariuszy, zaproponować ton komunikacji albo stworzyć pierwszą wersję oświadczenia. Nie zastąpi jednak rzecznika, prawnika, wykładowcy ani osoby decyzyjnej. Daje punkt wyjścia, który człowiek musi ocenić.

Flow i generowanie materiałów wizualnych

AI nie ogranicza się do tekstu. Może pomagać w tworzeniu obrazów i krótkich filmów, które wspierają dydaktykę, promocję i komunikację.

Na zajęciach studenci mogą np. przygotować wizualizację życia w starożytnym Egipcie, scenę inspirowaną literaturą albo film przedstawiający przyszłość miasta. Taki proces uczy nie tylko obsługi narzędzia, ale także precyzyjnego opisywania pomysłów, krytycznej oceny wyniku i poprawiania promptów.

Trzeba jednak zachować ostrożność. Wygenerowane obrazy mogą być atrakcyjne, ale nie zawsze poprawne merytorycznie. Przy użyciu wizerunku prawdziwych osób konieczna jest zgoda, dlatego w materiałach promocyjnych bezpieczniej bywa korzystać z postaci wygenerowanych przez AI.

Ograniczenia i ryzyka

Najważniejsze ograniczenie AI to omylność. Modele mogą:

halucynować, czyli tworzyć błędne lub zmyślone informacje,

źle interpretować dane,

upraszczać złożone problemy,

generować niepoprawne wykresy lub obrazy,

proponować odpowiedzi niedopasowane do kontekstu,

wskazywać źródła, które nie potwierdzają danej tezy.

Drugie ryzyko dotyczy danych. Nie należy wpisywać danych osobowych studentów, wyników testów, informacji wewnętrznych ani poufnych dokumentów do prywatnych narzędzi AI bez odpowiednich zabezpieczeń. W środowisku akademickim szczególne znaczenie mają konta edukacyjne, polityki organizacji i zgodność z RODO.

Trzecie ograniczenie to jakość instrukcji. Słabo opisany asystent będzie dawał słabe wyniki. Dobre narzędzie wymaga testowania, poprawiania i doprecyzowywania. Czasem AI nie oszczędza czasu od razu, ale inwestycja w dobrze przygotowany prompt lub GEM-a może się opłacić przy zadaniach powtarzalnych.